PNO - Rối loạn căng thẳng sau sang chấn (PTSD) lâu nay được xem là vấn đề đặc thù của con người sau những biến cố nghiêm trọng. Một nghiên cứu mới gây thu hút sự chú ý, đó là trí tuệ nhân tạo (AI) cũng có thể biểu hiện các dấu hiệu tương tự sang chấn tâm lý.

| Chia sẻ bài viết: |

Thuốc tiêm tiểu đường thế hệ mới giúp hạ đường huyết và giảm cân

Người trẻ ngày nay kém khỏe mạnh hơn thế hệ trước

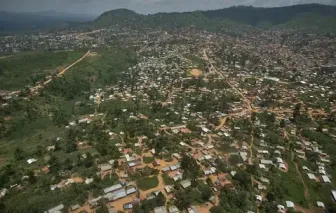

WHO lo ngại về 'quy mô và tốc độ' của đợt bùng phát Ebola chết người

Ebola: Chân dung loại vi rút chết người gây ám ảnh

Vì sao tàu Diamond Princess từ thiên đường nghỉ dưỡng trở thành ổ dịch trên biển?

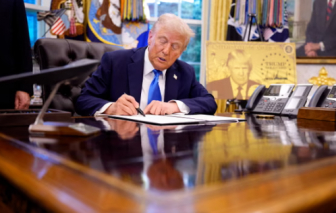

Ngày 9/6, Mỹ đã tiến hành các cuộc không kích mới nhằm vào Iran sau khi Tổng thống Trump cáo buộc Tehran bắn hạ 1 trực thăng của quân đội Mỹ.

Chính quyền Congo kêu gọi người dân đến các cơ sở y tế khi có dấu hiệu nhiễm bệnh, đồng thời tuân theo hướng dẫn của nhân viên y tế.

Nhiều ông bố nội trợ cho biết, điều quý giá nhất họ nhận được là cơ hội đồng hành cùng con trong những năm tháng đầu đời.

Tại nhiều quốc gia, độ tuổi làm cha đang tăng cao do áp lực kinh tế và xã hội. Việc làm cha muộn tiềm ẩn nguy cơ trầm cảm.

Tổng thống Mỹ Donald Trump cho biết 2 phi công trên chiếc trực thăng quân sự Mỹ gặp nạn gần eo biển Hormuz đều an toàn và không bị thương.

Từ tháng Bảy tới, phụ nữ tại nhiều địa phương ở Hàn Quốc sẽ có thể nhận băng vệ sinh miễn phí ở nhiều nơi công cộng.

Nghiên cứu mới tại Mỹ cho rằng điện thoại thông minh có thể là yếu tố góp phần làm giảm tỉ lệ sinh toàn cầu.

Trọng tài Omar Artan không thể tham dự World Cup 2026 sau khi bị từ chối nhập cảnh vào Mỹ.

Hàng trăm người tại thủ đô Wellington (New Zealand) phải sơ tán khẩn cấp khi những con sóng cao tới 11m cùng gió giật mạnh đổ bộ vào khu vực ven biển.

'Nền kinh tế bầu bạn' đang bùng nổ tại châu Á, phản ánh nhu cầu rất con người: được gắn kết giữa một thế giới thừa kết nối nhưng thiếu sẻ chia.

Israel tìm cách gây ảnh hưởng đến đàm phán hòa bình Mỹ - Iran sau đợt giao tranh ngắn với Tehran.

Tổng giám đốc IMF, bà Kristalina Georgieva cho rằng thế giới vẫn chưa thực sự “thấm nhuần” thực tế rằng các biến động lớn đang trở thành trạng thái bình thường.

Một thẩm phán liên bang Mỹ đã ra phán quyết hủy bỏ khoản phí thường niên 100.000 USD mà Tổng thống Trump áp đặt đối với các đơn xin thị thực H-1B.

Bà Han Seong-sook, cựu CEO của Tập đoàn công nghệ Naver, được kỳ vọng sẽ dẫn dắt quá trình chuyển đổi đất nước trong thời đại của trí tuệ nhân tạo.

Chiều ngày 8/6, giới chức Philippines cho biết, trận động đất 7,8 độ Richter tại miền nam đã khiến ít nhất 32 người thiệt mạng và 134 người bị thương.

Ngày 8/6, Tổng thống Mỹ Donald Trump đã kêu gọi Israel và Iran chấm dứt ngay các hành động quân sự sau khi 2 nước tiếp tục trả đũa lẫn nhau.

Ngày 7/6, hàng ngàn người dân đã đổ về đại lộ Paseo de la Reforma, để tham gia nỗ lực thiết lập kỷ lục Guinness thế giới.

Khi World Cup 2026 chỉ còn ít ngày nữa sẽ khởi tranh, không khí háo hức thường thấy tại Iran khá ảm đạm.