PNO - Trong cuộc đua kiểm soát công nghệ toàn cầu, Hàn Quốc vừa chính thức trở thành quốc gia đầu tiên trên thế giới thực thi một đạo luật toàn diện trên quy mô toàn quốc về trí tuệ nhân tạo (AI).

| Chia sẻ bài viết: |

Thực phẩm siêu chế biến đang bào mòn trí tuệ người dùng

Suy giảm sức khỏe trước tuổi nghỉ hưu lan rộng toàn cầu

Trẻ em nông thôn dễ trầm cảm hơn trẻ thành thị

'Oscar khoa học' vinh danh liệu pháp gen giúp phục hồi thị lực ở người bị mù di truyền

WHO phê duyệt phương pháp điều trị sốt rét đầu tiên dành riêng cho trẻ sơ sinh

Cuộc sống bí mật của những phụ nữ đứng sau đế chế ma túy Mỹ Latinh

Israel dọa ám sát bất kỳ ai kế nhiệm Lãnh tụ Tối cao Iran Ali Khamenei

Ảo ảnh hoang mạc tại Iran từng khiến đạo quân của Alexander Đại đế hoảng loạn

Thời đại giám sát tình báo: Mối nguy hiểm với các nhà lãnh đạo

Mỹ - Iran: Hành trình từ đồng minh đến kẻ thù

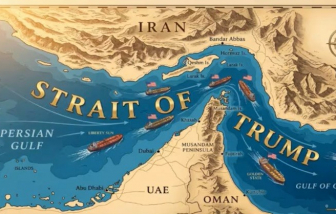

Hành động ngẫu hứng của Tổng thống Mỹ cùng lời cảnh báo phong tỏa Iran kéo dài đang khiến thị trường năng lượng chao đảo.

Một người đàn ông tại Malaysia, từng kết hôn tới 9 lần, đang tiếp tục đối mặt với cáo buộc hành hung vợ mang thai dẫn đến sảy thai.

Ngày càng nhiều lao động có bằng đại học tại châu Á đang lựa chọn những công việc không yêu cầu trình độ tương xứng.

Lebanon khẳng định sẽ không bước vào các cuộc đàm phán với Israel nếu lệnh ngừng bắn chưa được thực thi đầy đủ.

Cuộc xung đột tại eo biển Hormuz đẩy hàng triệu người vào cảnh đói khát và thiếu thuốc men, khiến việc thiết lập một hành lang nhân đạo trở nên cấp thiết.

Tổng thống Donald Trump không dỡ bỏ phong tỏa eo biển Hormuz trong bối cảnh cuộc chiến với Iran đã tiêu tốn của Mỹ khoản ngân sách khổng lồ 25 tỉ USD.

Giá dầu thế giới tăng mạnh khoảng 5% trong ngày 29/4.

Nghiên cứu từ Canada cho thấy, các nguồn sóng hạ âm ở dưới ngưỡng nghe được vẫn có thể ảnh hưởng đến cảm nhận của con người.

Tình trạng suy giảm sức khỏe trước tuổi nghỉ hưu đang trở thành xu hướng đáng lo trên phạm vi toàn cầu.

Ngày 29/4, Tổng thống Trump đã đưa ra những chỉ trích gay gắt nhằm vào Iran khi các cuộc đàm phán về chương trình hạt nhân của Tehran rơi vào bế tắc.

Giữa nhịp sống hối hả, các ngôi chùa tại Hàn Quốc đang trở thành cầu nối, giúp người trẻ tìm thấy một nửa của mình.

Động thái này được xem là bước đi hiếm thấy, phá vỡ thông lệ lâu nay trong việc thiết kế tài liệu quốc gia.

Nỗ lực chấm dứt xung đột Mỹ - Iran bế tắc sau khi Tổng thống Donald Trump bác bỏ đề xuất hòa bình mới nhất từ Tehran.

Các nước Vùng Vịnh bác bỏ phí quá cảnh của Iran tại eo biển Hormuz, tuyên bố hành động này bất hợp pháp và yêu cầu duy trì tự do hàng hải.

Trong kỷ nguyên kết nối không giới hạn, việc tìm kiếm đối tượng hẹn hò lẽ ra phải dễ dàng hơn bao giờ hết.

Ngày 28/4, các Tiểu vương quốc Ả Rập Thống nhất (UAE) tuyên bố sẽ rút khỏi Tổ chức Các nước Xuất khẩu Dầu mỏ (OPEC) và liên minh OPEC+.

Sự bất ổn tại các eo biển chiến lược đang đặt tuyến hàng hải Malacca vào tình thế nhạy cảm, đe dọa trực tiếp đến dòng chảy kinh tế toàn cầu.

Cựu Đệ nhất phu nhân Hàn Quốc bị tuyên 4 năm tù giam, phạt 50 triệu won và buộc bồi thường 20,94 triệu won tội thao túng cổ phiếu, nhận hối lộ.