PNO - 19% người dùng từ 13-15 tuổi cho biết đã nhìn thấy ảnh khỏa thân hoặc hình ảnh khiêu dâm trên Instagram mà họ không muốn xem.

| Chia sẻ bài viết: |

'Oscar khoa học' vinh danh liệu pháp gen giúp phục hồi thị lực ở người bị mù di truyền

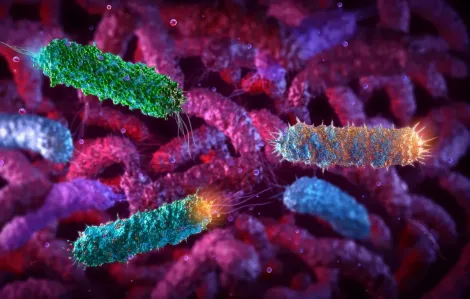

Biến vi khuẩn E.coli thành 'vũ khí' tiêu diệt ung thư vú

AI chẩn đoán bệnh sai hơn 80%

Tiêm vắc xin HPV giúp bảo vệ phái mạnh khỏi nhiều loại ung thư nguy hiểm

Phát hiện vi khuẩn có khả năng bảo vệ cơ thể trước hội chứng COVID kéo dài

Israel dọa ám sát bất kỳ ai kế nhiệm Lãnh tụ Tối cao Iran Ali Khamenei

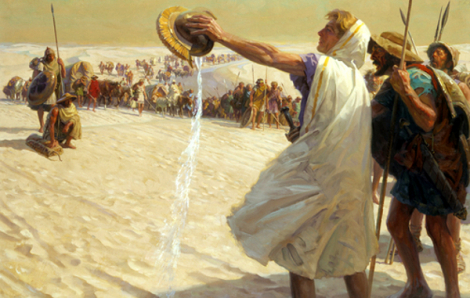

Ảo ảnh hoang mạc tại Iran từng khiến đạo quân của Alexander Đại đế hoảng loạn

Thời đại giám sát tình báo: Mối nguy hiểm với các nhà lãnh đạo

Mỹ - Iran: Hành trình từ đồng minh đến kẻ thù

Vì sao tình báo Iran tê liệt khi Mỹ-Israel không kích khiến hàng loạt chỉ huy thiệt mạng?

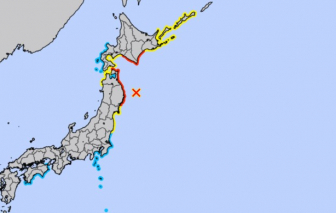

Cơ quan Khí tượng Nhật Bản phát đi cảnh báo đặc biệt về nguy cơ xảy ra siêu động đất sau trận rung chấn mạnh 7,7 độ vào chiều ngày 20/4.

Iran tuyên bố chưa có kế hoạch đàm phán với Mỹ, bất chấp các thông tin về nỗ lực hòa giải quốc tế nhằm đưa hai bên trở lại đối thoại.

Ngày 20/4, một trận động đất mạnh 7,5 độ richter đã xảy ra ngoài khơi bờ biển đông bắc Nhật Bản.

Hàng chục ngàn gia đình tại Iran đang rơi vào cảnh mất chỗ ở sau các đợt không kích trong chiến sự với Mỹ và Israel.

Căng thẳng tại Trung Đông đang leo thang trở lại khi thỏa thuận ngừng bắn giữa Mỹ và Iran đứng trước nguy cơ đổ vỡ...

Căng thẳng khu vực leo thang sau vụ việc Mỹ bắt giữ tàu hàng và Iran tấn công trả đũa bằng máy bay không người lái trên Biển Oman.

Một vụ xả súng nghiêm trọng trong gia đình tại bang Louisiana (Mỹ) đã khiến 8 trẻ em thiệt mạng, gây chấn động dư luận.

Hy vọng về một bước ngoặt ngoại giao giữa Iran và Mỹ vừa bị dập tắt khi Tehran tuyên bố từ chối tham gia vòng đàm phán thứ hai.

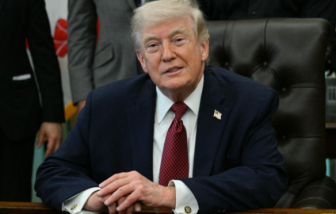

Tổng thống Mỹ Donald Trump cảnh báo rằng đây là "cơ hội cuối cùng" để Iran ký kết thỏa thuận hòa bình trước khi đối mặt với kịch bản quân sự.

Ngày 18/4, giải thưởng Breakthrough Prize – vừa được trao cho nhóm nghiên cứu phát triển liệu pháp gen đầu tiên giúp phục hồi thị lực ở người bị mù di truyền.

Lãnh tụ Tối cao Mojtaba Khamenei cho biết trong thông điệp phát trên truyền hình Iran rằng Iran sẽ cho Mỹ và Israel trải nghiệm thất bại cay đắng.

Nhật Bản triển khai các dịch vụ dành riêng cho người khiếm thính, hỗ trợ họ trong những hoạt động thường nhật như mua sắm, làm đẹp hay ăn uống.

Những dòng trạng thái vội vã trên mạng xã hội đang đẩy mối quan hệ Mỹ - Iran vào thế bế tắc, biến không gian ảo thành chiến trường ngoại giao mới.

Ngày 19/4, Mỹ được cho là đang chuẩn bị triển khai một chiến dịch hàng hải quy mô toàn cầu, nhắm vào các tàu thuyền có liên hệ với Iran.

Lệnh ngừng bắn 10 ngày mang lại yên ắng mong manh ở Lebanon, nhưng người dân vẫn lo xung đột tái bùng phát.

Hội đồng An ninh Quốc gia Tối cao Iran cho biết đang xem xét các đề xuất mới từ Mỹ đồng thời khẳng định sẽ không thỏa hiệp với Washington.

Ngày 18/4, Tổng thống Mỹ Donald Trump đã triệu tập cuộc họp khẩn tại Phòng Tình huống Nhà Trắng để thảo luận về diễn biến căng thẳng quanh eo biển Hormuz.

Có bao giờ bạn thắc mắc tại sao cùng một công việc nhưng có ngày bạn giải quyết cực nhanh, có ngày lại thấy trì trệ như đang đi trong sương mù?