PNO - Nhiều báo cáo gần đây cảnh báo đã xuất hiện các triệu chứng hoang tưởng, rối loạn tâm thần sau khi trò chuyện với chatbot trong thời gian dài ở một nhóm nhỏ người dùng. Hiện tượng này được gọi là “AI psychosis” hay “ChatGPT psychosis” (rối loạn tâm thần AI).

| Chia sẻ bài viết: |

Thực phẩm siêu chế biến đang bào mòn trí tuệ người dùng

Suy giảm sức khỏe trước tuổi nghỉ hưu lan rộng toàn cầu

Trẻ em nông thôn dễ trầm cảm hơn trẻ thành thị

'Oscar khoa học' vinh danh liệu pháp gen giúp phục hồi thị lực ở người bị mù di truyền

WHO phê duyệt phương pháp điều trị sốt rét đầu tiên dành riêng cho trẻ sơ sinh

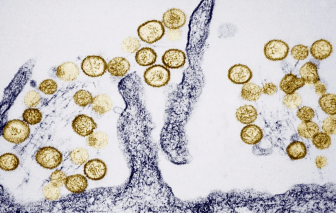

Một căn bệnh hiếm gặp bất ngờ xuất hiện giữa đại dương và cướp đi sinh mạng của 3 người. Vi rút Hanta thực chất nguy hiểm đến mức nào?

WHO và Bộ Y tế Nam Phi thông báo chính thức về một sự cố y tế nghiêm trọng xảy ra trên tàu du lịch hạng sang trên Đại Tây Dương.

Giữa bối cảnh giá nhiên liệu leo thang và áp lực ngân sách tại Mỹ, Iran dự kiến đề xuất 14 điểm sẽ giúp chấm dứt xung đột trong 30 ngày.

Chính phủ Tây Ban Nha xác nhận máy bay chở Thủ tướng Pedro Sanchez đã phải hạ cánh khẩn cấp xuống Thổ Nhĩ Kỳ vào tối ngày 3/5, do gặp sự cố.

Buổi sáng ở Gaza Strip không bắt đầu bằng tiếng chuông trường.

Eo biển Hormuz “đóng băng” khiến dòng viện trợ nhân đạo toàn cầu bị tắc nghẽn.

Mới đây, ông Trump đã gây chú ý khi nói đùa rằng Hải quân Mỹ có thể 'tiếp quản Cuba' trên đường trở về sau các hoạt động quân sự tại Iran.

Cá lau kính đang xâm chiếm các dòng sông Đông Nam Á, tiêu diệt loài bản địa và đe dọa hệ sinh thái, buộc các quốc gia phải nhanh chóng xử lý.

Nhiều quốc gia Trung Đông đang tăng tốc xây dựng những hành lang vận tải mới nhằm giảm phụ thuộc vào eo biển Hormuz.

Iran vừa gửi đề xuất 14 điểm nhằm chấm dứt chiến tranh, nhưng Tổng thống Mỹ Donald Trump vẫn hoài nghi và cảnh báo về khả năng tấn công quân sự.

Tổng thống Mỹ Donald Trump đang đứng trước nguy cơ sa lầy trong một thế bế tắc kéo dài với Iran, có thể để lại những hệ lụy nghiêm trọng hơn

Iran tuyên bố lựa chọn theo đuổi giải pháp đàm phán hay quay trở lại chiến tranh phụ thuộc vào phía Mỹ, song Tehran đã sẵn sàng cho cả hai kịch bản.

Một xu hướng đang lan rộng trong giới trẻ tại Trung Quốc là dùng trí tuệ nhân tạo để "tái tạo" người yêu cũ thành chatbot.

Cuộc chiến tại Trung Đông đẩy các ngân hàng trung ương lớn vào thế nan giải giữa mục tiêu kiềm chế lạm phát và thúc đẩy tăng trưởng kinh tế.

Trong khi phần lớn quốc gia và người dân phải gánh chịu tổn thất, một số ngành lại nổi lên như những “điểm sáng lợi nhuận” trong cơn bão địa chính trị.

Quan hệ giữa Mỹ và Iran tiếp tục xấu đi khi cả hai bên đồng thời gia tăng cảnh báo và biện pháp gây sức ép.

Sau 2 tháng, giao tranh Mỹ–Iran tạm lắng, chưa có chiến thắng rõ ràng, trong khi hệ lụy lan rộng, đẩy nhiều quốc gia và người dân vào vòng xoáy tổn thất.

Chính quyền ông Donald Trump quyết định rút khoảng 5.000 binh sĩ khỏi Đức, trong bối cảnh quan hệ giữa Washington và Berlin gia tăng căng thẳng liên quan đến Iran.