PNO - Khi các nhà nghiên cứu đóng vai kẻ có ý định sử dụng súng đạn hoặc bạo lực, nhiều chatbot đều sẵn sàng hướng dẫn cách thực hiện tội ác.

| Chia sẻ bài viết: |

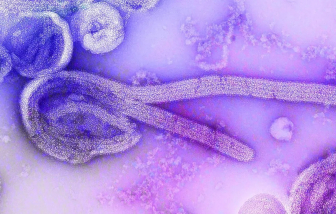

WHO lo ngại về 'quy mô và tốc độ' của đợt bùng phát Ebola chết người

Ebola: Chân dung loại vi rút chết người gây ám ảnh

Vì sao tàu Diamond Princess từ thiên đường nghỉ dưỡng trở thành ổ dịch trên biển?

WHO: Chưa có dấu hiệu dịch vi rút Hanta lan rộng thành đại dịch

Thực phẩm siêu chế biến đang bào mòn trí tuệ người dùng

Ngày 19/5, Tổng thống Mỹ Donald Trump tuyên bố ông từng "ở rất gần" quyết định phát động một đợt tấn công mới nhằm vào Iran.

Ngoại trưởng Anh cảnh báo thế giới bên bờ vực “khủng hoảng lương thực toàn cầu”, trong bối cảnh hoạt động hàng hải qua eo biển Hormuz tiếp tục bị gián đoạn.

Ngày 19/5, WHO bày tỏ quan ngại sâu sắc về “quy mô và tốc độ” của đợt bùng phát Ebola mới tại Congo, khi dịch bệnh đã khiến 131 người chết.

Theo phóng viên TTXVN tại La Habana, một tàu của Mexico chở 1.700 tấn lương thực từ Mexico và Uruguay, đã cập cảng La Habana nhằm trợ giúp người dân Cuba.

Ngày 19/5, các nhà chức trách Na Uy thông báo bệnh cúm gia cầm đã được ghi nhận lần đầu tiên ở một con gấu Bắc Cực tại châu Âu.

Theo các chuyên gia, AI đang tạo ra sự chuyển đổi lớn cho thị trường lao động toàn cầu.

Giữa vòng vây tự động hóa và trí tuệ nhân tạo (AI), thế hệ trẻ đang chuyển dịch sang những việc cần sức người như sửa chữa, điều dưỡng, giáo viên.

Nhiều quốc gia Đông Nam Á đang đồng loạt nâng cao mức độ cảnh giác, siết chặt quy trình sàng lọc dịch bệnh tại các cửa ngõ quốc tế.

Ngày 19/5, Iran lần đầu tiên công khai các nội dung chính trong đề xuất hòa bình mới gửi tới Mỹ.

Từng được xem là thế hệ gắn bó mật thiết nhất với công nghệ, nhưng ngày càng nhiều người trẻ quay lưng với trí tuệ nhân tạo.

Hàn Quốc đang thắt chặt kỷ luật bằng cách đưa hồ sơ bạo lực học đường vào tiêu chí xét tuyển của toàn bộ các trường đại học từ năm 2026.

Ngày 18/5, Tổng thống Mỹ Donald Trump cho biết ông đã tạm dừng một cuộc tấn công quân sự vào Iran sau khi Tehran gửi đề xuất hòa bình mới tới Washington.

Tỉ phú Elon Musk vừa nhận thất bại lớn trong cuộc chiến pháp lý kéo dài với Sam Altman.

Tổng giám đốc WHO cho biết dịch bệnh do vi rút Hanta và Ebola gây ra những cuộc khủng hoảng mới nhất trong thời kỳ “nguy hiểm và chia rẽ”.

Giới chức y tế bang Colorado khẳng định, trường hợp nhiễm vi rút Hanta và qua đời ở địa phương này không liên quan đến ổ dịch trên tàu MV Hondius.

Ngày 18/5, Hội đồng An ninh quốc gia tối cao Iran chính thức công bố thành lập cơ quan mới phụ trách quản lý eo biển Hormuz.

Một bác sĩ phẫu thuật tại Thượng Hải (Trung Quốc) đang gây chú ý trên mạng xã hội khi chia sẻ tình trạng tăng cân do áp lực nghề nghiệp.

Ngày càng nhiều người trẻ tại Hàn Quốc cho rằng chuyện yêu đương đang trở thành áp lực tài chính trong bối cảnh chi phí sinh hoạt liên tục tăng cao.