| Chia sẻ bài viết: |

Người trẻ ngày nay kém khỏe mạnh hơn thế hệ trước

WHO lo ngại về 'quy mô và tốc độ' của đợt bùng phát Ebola chết người

Ebola: Chân dung loại vi rút chết người gây ám ảnh

Vì sao tàu Diamond Princess từ thiên đường nghỉ dưỡng trở thành ổ dịch trên biển?

WHO: Chưa có dấu hiệu dịch vi rút Hanta lan rộng thành đại dịch

Nhiều người trẻ đã lựa chọn tạm dừng công việc trong vài tháng hoặc vài năm để nghỉ ngơi, trải nghiệm và tái tạo năng lượng.

Đô thị đắt đỏ, ngột ngạt và thiếu không gian vui chơi đang đẩy các gia đình có con trẻ dạt ra vùng ngoại thành.

Iran đang xem xét đề xuất thỏa thuận mới của Mỹ nhằm chấm dứt cuộc xung đột kéo dài hơn 3 tháng qua, song đến nay vẫn chưa phản hồi chính thức.

Tổ chức Khí tượng Thế giới vừa cảnh báo hiện tượng El Nino đang hình thành và có khả năng phát triển ở mức mạnh trong những tháng tới.

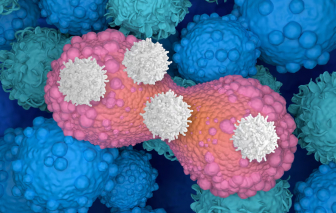

Một loại thuốc thử nghiệm mới mang đến hy vọng cho bệnh nhân ung thư sau khi cho thấy khả năng thu nhỏ khối u hiệu quả.

Ngày 2/6, Tổng thống Trump cho biết ông kỳ vọng Washington và Tehran có thể đạt được một thỏa thuận trong vòng tuần tới nhằm gia hạn lệnh ngừng bắn hiện nay.

Ngày 2/6, Tổng thống Trump đã có cuộc điện đàm căng thẳng với ông Benjamin Netanyahu, trong đó ông chỉ trích mạnh mẽ các hoạt động quân sự của Israel tại Lebanon

Tổng thống John Dramani Mahama đã phê chuẩn luật mới, quy định án tù cho những hành vi quảng bá quan hệ chống lại hôn nhân truyền thống.

Ngày 2/6, Tổng thống Mỹ Donald Trump tuyên bố Israel và Hezbollah đã đồng ý ngừng bắn, đồng thời bày tỏ hy vọng thỏa thuận này sẽ được duy trì lâu dài.

Hàng dài người trẻ kiên nhẫn xếp hàng chờ đến lượt xem bói tại “Fortune Adventure 2026” - hội chợ chuyên về vận mệnh đầu tiên được tổ chức tại Hàn Quốc.

Truyền thông nhà nước Iran vừa thông báo Tehran đình chỉ các cuộc đàm phán với Mỹ nhằm phản đối việc Israel liên tục leo thang tấn công quân sự vào Lebanon.

Ngày 1/6, một vụ nổ xảy ra tại nhà máy của Hanwha Aerospace ở thành phố Daejeon (Hàn Quốc) đã khiến 5 người thiệt mạng và 2 người bị thương.

Mỹ đang thúc đẩy kế hoạch giảm căng thẳng giữa Israel và Lebanon, trong đó yêu cầu lực lượng Hezbollah chấm dứt mọi cuộc tấn công nhằm vào Israel.

Giữa lúc lệnh ngừng bắn mong manh bị lung lay bởi các đợt giao tranh mới, Tổng thống Donald Trump bất ngờ yêu cầu chỉnh sửa dự thảo thỏa thuận với Iran.

Khi đến quán, khách không chỉ gọi cocktail hay trò chuyện cùng bạn bè mà còn được nghe các nhà sư tụng kinh, cho lời khuyên về cuộc sống.

Từng gắn với hình ảnh mạnh mẽ, ít quan tâm đến chăm sóc cá nhân, đàn ông Trung Quốc ngày nay đang trở thành lực lượng tiêu dùng của ngành làm đẹp.

Nhiều nước từng đối mặt với sự hoài nghi khi triển khai xăng E10. Chuyển đổi xanh không chỉ cần công nghệ hay chính sách, mà còn niềm tin xã hội.

Iran tuyên bố không tin tưởng Mỹ sẽ thực hiện các cam kết trong bất kỳ thỏa thuận nào giữa hai nước.